Classification des Méthodes d'Optimisation: Un Guide Complet

Découvrez les différentes approches pour résoudre les problèmes d'optimisation, des méthodes déterministes aux algorithmes stochastiques.

Points Clés des Méthodes d'Optimisation

- Méthodes Déterministes vs. Stochastiques: Comprendre les différences fondamentales dans la recherche de solutions optimales.

- Optimisation Linéaire et Non Linéaire: Identifier quand utiliser chaque approche en fonction de la nature du problème.

- Applications Pratiques: Explorer comment l'optimisation est utilisée dans divers domaines tels que l'ingénierie, la finance et l'IA.

Comprendre l'Optimisation: Définition et Importance

L'optimisation est une branche des mathématiques qui vise à trouver la meilleure solution parmi un ensemble de solutions possibles. Elle consiste à maximiser ou minimiser une fonction objectif, tout en respectant certaines contraintes. Cette discipline est essentielle dans de nombreux domaines, notamment l'ingénierie, la finance, l'économie et l'informatique. L'optimisation permet d'améliorer l'efficacité, de réduire les coûts et d'optimiser les performances des systèmes et des processus.

Dans le contexte de la recherche opérationnelle, l'optimisation joue un rôle crucial. Elle permet de modéliser, d'analyser et de résoudre des problèmes complexes de manière analytique ou numérique. Que ce soit pour la gestion des ressources, la planification de la production ou la conception de réseaux, l'optimisation offre des outils puissants pour prendre des décisions éclairées.

Classification Fondamentale des Méthodes d'Optimisation

Les méthodes d'optimisation peuvent être classées en deux grandes catégories: les méthodes déterministes et les méthodes stochastiques.

Méthodes Déterministes: Une Approche Structurée

Les méthodes déterministes sont caractérisées par une approche systématique et prévisible. Elles suivent un ensemble de règles fixes pour explorer l'espace de recherche et converger vers une solution optimale. Ces méthodes sont particulièrement efficaces lorsque le problème d'optimisation est bien défini, avec des contraintes claires et une fonction objectif lisse.

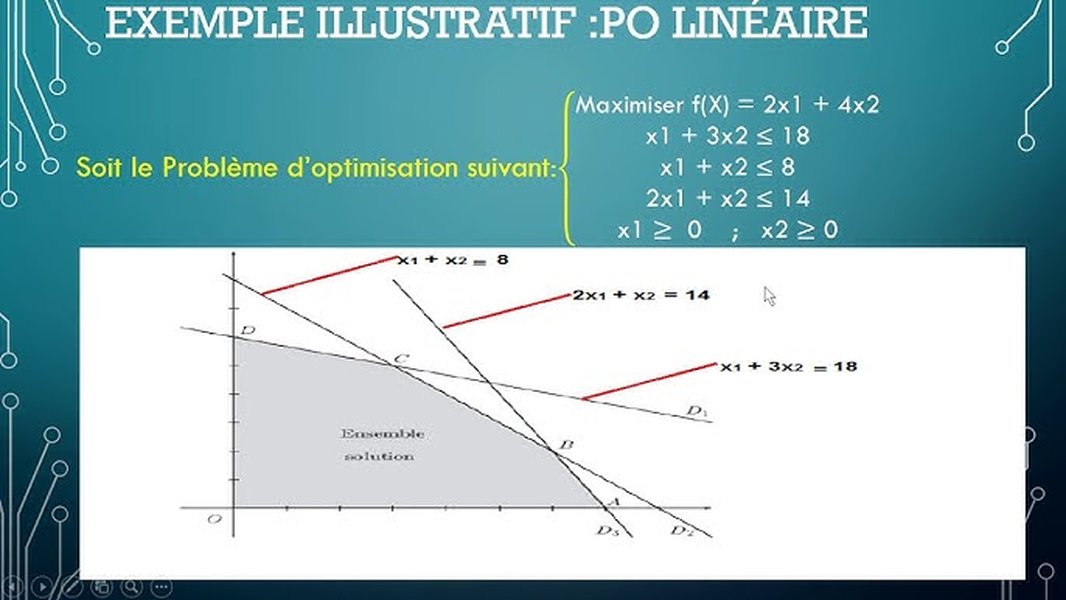

Optimisation Linéaire: Quand les Relations Sont Simples

L'optimisation linéaire (PL) est une technique mathématique utilisée pour obtenir le meilleur résultat possible (profit maximal ou coût minimal) dans un modèle où les exigences sont représentées par des relations linéaires. Elle est largement utilisée dans la planification de la production, la gestion des stocks et la logistique.

Programmation Non Linéaire: Gestion de la Complexité

La programmation non linéaire traite des problèmes où la fonction objectif, les contraintes, ou les deux, contiennent des fonctions non linéaires des variables de décision. Ces problèmes sont souvent plus difficiles à résoudre que les problèmes linéaires, mais ils peuvent modéliser des situations plus réalistes.

Programmation Quadratique Séquentielle (SQP): Efficacité pour les Problèmes Contraints

La méthode SQP est une méthode de programmation non linéaire particulièrement efficace pour résoudre des problèmes d'optimisation avec des contraintes de taille petite et moyenne. Elle a été reconnue comme l'une des méthodes les plus performantes dans ce domaine.

Méthodes Stochastiques: Gérer l'Incertitude

Les méthodes stochastiques, quant à elles, introduisent un élément d'aléatoire dans le processus de recherche. Elles sont particulièrement utiles lorsque le problème d'optimisation est complexe, avec de nombreuses variables, des contraintes non linéaires ou une fonction objectif irrégulière. Ces méthodes sont capables d'échapper aux optima locaux et d'explorer l'espace de recherche de manière plus globale.

Ces méthodes ont une grande capacité à trouver l’optimum global du problème, mais peuvent conduire à des résultats différents pour une même configuration initiale.

Algorithmes Génétiques: S'Inspirer de la Nature

Les algorithmes génétiques sont inspirés par le processus d'évolution naturelle. Ils utilisent des concepts tels que la sélection, la mutation et le croisement pour faire évoluer une population de solutions potentielles vers une solution optimale. Ces algorithmes sont particulièrement adaptés aux problèmes d'optimisation combinatoire.

Recuit Simulé: Un Processus de Refroidissement Contrôlé

Le recuit simulé est une méthode stochastique qui s'inspire du processus de refroidissement des métaux. Elle permet d'éviter de rester piégé dans des optima locaux en acceptant temporairement des solutions moins bonnes. Au fur et à mesure que la température diminue, la probabilité d'accepter des solutions moins bonnes diminue également, ce qui permet de converger vers une solution optimale.

Autres Classifications des Problèmes d'Optimisation

Outre la distinction entre méthodes déterministes et stochastiques, les problèmes d'optimisation peuvent être classés selon d'autres critères, tels que la nature des variables et la connaissance des données.

- Optimisation Continue vs. Discrète: Dans l'optimisation continue, les variables peuvent prendre n'importe quelle valeur réelle, tandis que dans l'optimisation discrète, les variables sont limitées à des valeurs entières ou binaires.

- Optimisation Déterministe vs. Stochastique (selon les données): Dans l'optimisation déterministe, les données sont supposées parfaitement connues, tandis que dans l'optimisation stochastique, les données sont incertaines et peuvent être représentées par des distributions de probabilité.

- Optimisation avec Contraintes vs. Sans Contraintes: Certains problèmes d'optimisation sont soumis à des contraintes qui limitent les valeurs des variables, tandis que d'autres ne le sont pas.

Tableau Récapitulatif des Méthodes d'Optimisation

Pour mieux comprendre les différentes méthodes d'optimisation, voici un tableau récapitulatif qui présente leurs principales caractéristiques et applications.

| Méthode d'Optimisation | Type | Description | Applications | Avantages | Inconvénients |

|---|---|---|---|---|---|

| Optimisation Linéaire | Déterministe | Maximisation ou minimisation d'une fonction linéaire sous contraintes linéaires | Planification de la production, gestion des stocks, logistique | Simple à mettre en œuvre, solutions optimales garanties | Applicable uniquement aux problèmes linéaires |

| Programmation Non Linéaire | Déterministe | Optimisation d'une fonction non linéaire sous contraintes non linéaires | Conception de réseaux, optimisation de processus chimiques | Peut modéliser des situations complexes | Plus difficile à résoudre que l'optimisation linéaire, risque de convergence vers des optima locaux |

| Algorithmes Génétiques | Stochastique | Algorithmes inspirés par l'évolution naturelle, utilisant la sélection, la mutation et le croisement | Optimisation combinatoire, conception de circuits électroniques | Peut trouver des solutions optimales globales, robuste aux problèmes complexes | Peut être coûteux en temps de calcul, nécessite un réglage fin des paramètres |

| Recuit Simulé | Stochastique | Méthode inspirée par le refroidissement des métaux, permettant d'échapper aux optima locaux | Planification de tournées, optimisation de la configuration de machines | Simple à mettre en œuvre, peut trouver des solutions proches de l'optimum global | Nécessite un réglage fin des paramètres, peut être lent pour les problèmes de grande taille |

| Programmation Quadratique Séquentielle (SQP) | Déterministe | Méthode itérative pour résoudre des problèmes d'optimisation non linéaire avec des contraintes | Conception de structures mécaniques, optimisation de trajectoires | Efficace pour les problèmes avec un nombre limité de contraintes | Peut être sensible aux conditions initiales, nécessite des informations sur le gradient de la fonction objectif |

Optimisation Multimodale et Algorithmes Métaheuristiques

L'optimisation multimodale se concentre sur l'identification de multiples solutions optimales dans un problème d'optimisation, plutôt que de se contenter d'en trouver une seule. Cette approche est particulièrement utile dans les situations où il existe plusieurs configurations ou paramètres qui peuvent donner des résultats similaires en termes de performance ou d'efficacité.

Les algorithmes métaheuristiques sont des méthodes d'optimisation de haut niveau conçues pour résoudre des problèmes complexes pour lesquels les algorithmes traditionnels ne sont pas efficaces. Ces algorithmes combinent souvent des éléments aléatoires et des règles heuristiques pour explorer l'espace de recherche et trouver des solutions de bonne qualité en un temps raisonnable.

Voici quelques exemples d'algorithmes métaheuristiques utilisés dans l'optimisation multimodale :

- Algorithmes évolutionnaires multimodaux : Ces algorithmes étendent les algorithmes évolutionnaires traditionnels pour maintenir une population diversifiée de solutions, permettant ainsi d'identifier plusieurs optima.

- Algorithmes de colonies de particules multimodaux : Ces algorithmes adaptent les algorithmes de colonies de particules pour explorer l'espace de recherche de manière à identifier plusieurs régions prometteuses.

- Algorithmes de recherche tabou multimodaux : Ces algorithmes utilisent une mémoire tabou pour éviter de revisiter les solutions précédemment explorées, encourageant ainsi la diversification de la recherche.

L'utilisation de l'optimisation multimodale et des algorithmes métaheuristiques peut être bénéfique dans divers domaines, notamment :

-

Conception d'ingénierie : Identifier plusieurs conceptions qui répondent aux exigences de performance.

-

Planification de trajectoires : Trouver plusieurs trajectoires alternatives pour un robot ou un véhicule.

-

Optimisation de portefeuilles financiers : Identifier plusieurs portefeuilles qui offrent un bon compromis entre risque et rendement.

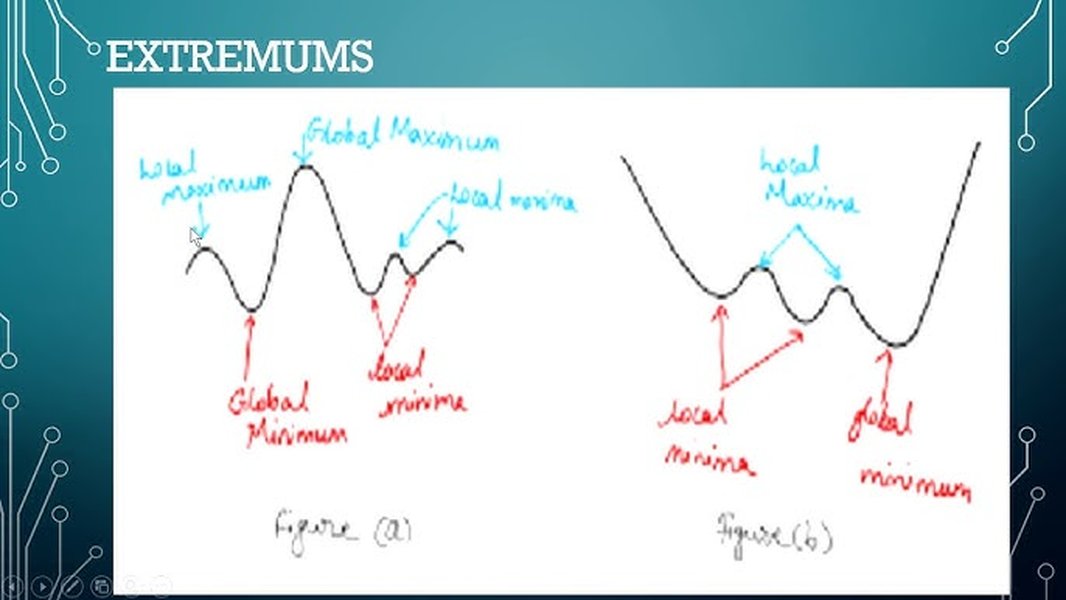

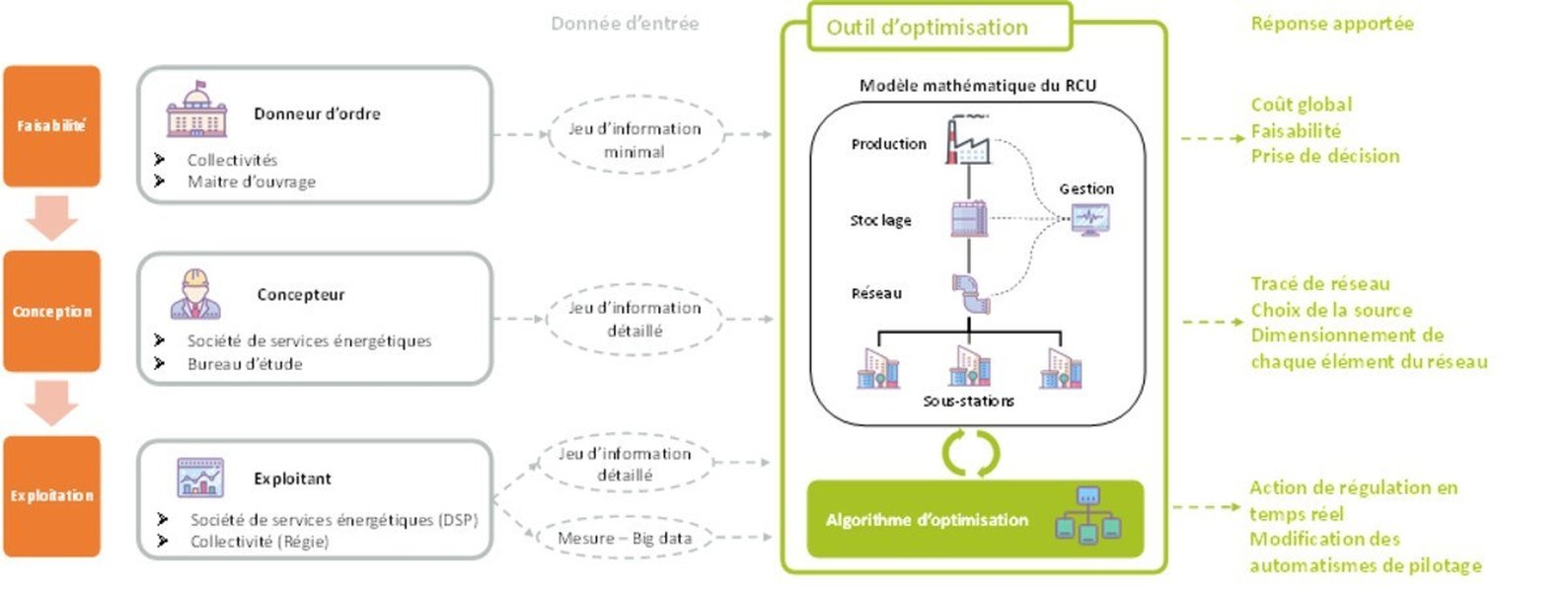

Visualisation des Méthodes d'Optimisation

Voici une représentation visuelle des différentes méthodes d'optimisation.

Introduction générale aux méthodes d'optimisation et définition des problèmes d'optimisation.

Résolution géométrique d'un problème d'optimisation linéaire avec un exercice corrigé.

Les méthodes numériques d'optimisation comme levier de déploiement et garant de performance des réseaux de chaleur et de froid.

Vidéo: Types et Classification des Méthodes d'Optimisation

Cette vidéo explique les différents types de méthodes d'optimisation, incluant les méthodes discrètes vs continues, linéaires vs non linéaires, et déterministes vs stochastiques. Comprendre ces classifications est essentiel pour choisir la méthode appropriée pour un problème d'optimisation donné.

FAQ sur les Méthodes d'Optimisation

Références

Last updated April 10, 2025