Разблокируйте Потенциал: Нецензурированные LLM для Ollama

Подробный обзор больших языковых моделей без ограничений цензуры, доступных для локальной установки.

Ключевые Моменты

- Ollama как Платформа: Ollama — это оптимальный инструмент для локального запуска нецензурированных LLM, позволяющий использовать мощные модели без облачных ограничений.

- Разнообразие Моделей: Доступен широкий спектр нецензурированных моделей, включая Llama 2 Uncensored, WizardLM Uncensored, Dolphin Mixtral, Nous Hermes Llama 2 и другие, каждая из которых имеет свои уникальные особенности.

- Этические Соображения: Хотя нецензурированные LLM предлагают большую гибкость, важно осознавать потенциальные этические риски, связанные с генерацией нефильтрованного или вредоносного контента.

Большие языковые модели (LLM) стали мощным инструментом в различных областях, от генерации текста до кодирования и исследований. Однако многие стандартные LLM включают встроенные механизмы цензуры и фильтрации, которые могут ограничивать их применение в некоторых сценариях. В ответ на это были разработаны "нецензурированные" версии этих моделей, которые модифицированы для снижения или полного устранения таких ограничений. Эти модели предоставляют пользователям большую гибкость и контроль над генерируемым контентом, что делает их идеальными для творческих, исследовательских или специализированных задач.

Ollama — это легкая и расширяемая платформа, которая упрощает процесс локальной установки и запуска LLM на вашем компьютере. Она устраняет необходимость в сложной настройке и управлении зависимостями, позволяя пользователям быстро загружать и взаимодействовать с моделями. Ниже представлен подробный список нецензурированных LLM, которые можно установить и использовать через Ollama, с описанием их ключевых особенностей, требований и команд для запуска.

Интерфейс Ollama, демонстрирующий легкость установки и управления моделями.

Основы Нецензурированных LLM

Что такое "Нецензурированные" Модели и Зачем Они Нужны?

«Нецензурированные» LLM — это версии больших языковых моделей, которые были доработаны или обучены таким образом, чтобы минимизировать или полностью исключить внутренние механизмы цензуры, часто называемые «выравниванием» (alignment) или «фильтрацией». Эти механизмы обычно предназначены для предотвращения генерации вредоносного, неэтичного или социально неприемлемого контента.

Основная причина создания таких моделей заключается в стремлении к большей гибкости и свободе в генерации текста. Это особенно важно для исследователей, разработчиков и пользователей, которым требуется доступ к необработанным возможностям LLM без ограничений. Например, в таких сценариях:

- Научные исследования: Для изучения поведения LLM без предустановленных фильтров.

- Творческое письмо: Для генерации контента, который может быть признан «спорным» стандартными моделями.

- Специализированные задачи: В областях, где требуется отсутствие предвзятости или отказ от ответа на чувствительные запросы, например, для юридических или медицинских целей (при соблюдении этических норм).

- Оценка безопасности: Для тестирования устойчивости систем к генерации вредоносного контента.

Процесс Доработки: Как Снимается Цензура?

Цензура в LLM чаще всего устраняется путем:

- Переобучения на альтернативных датасетах: Модели дообучаются на данных, которые не содержат морализаторских ответов или включают примеры нефильтрованного контента.

- Изменения системных подсказок: Внутренние инструкции, управляющие поведением модели, модифицируются, чтобы уменьшить ее склонность к цензурированию.

- Удаления выравнивания: Специальные техники, такие как откат выравнивания (un-alignment), используются для отмены эффектов обучения с подкреплением на основе человеческой обратной связи (RLHF), которое часто используется для внедрения цензуры.

Ollama: Ваша Локальная Платформа для LLM

Простота Установки и Использования

Ollama выделяется как один из самых удобных инструментов для работы с LLM на локальной машине. Он обеспечивает легкий процесс установки и позволяет запускать модели с минимальными усилиями. Это особенно полезно для экспериментов с нецензурированными моделями, поскольку все операции выполняются на вашем устройстве, обеспечивая конфиденциальность и контроль.

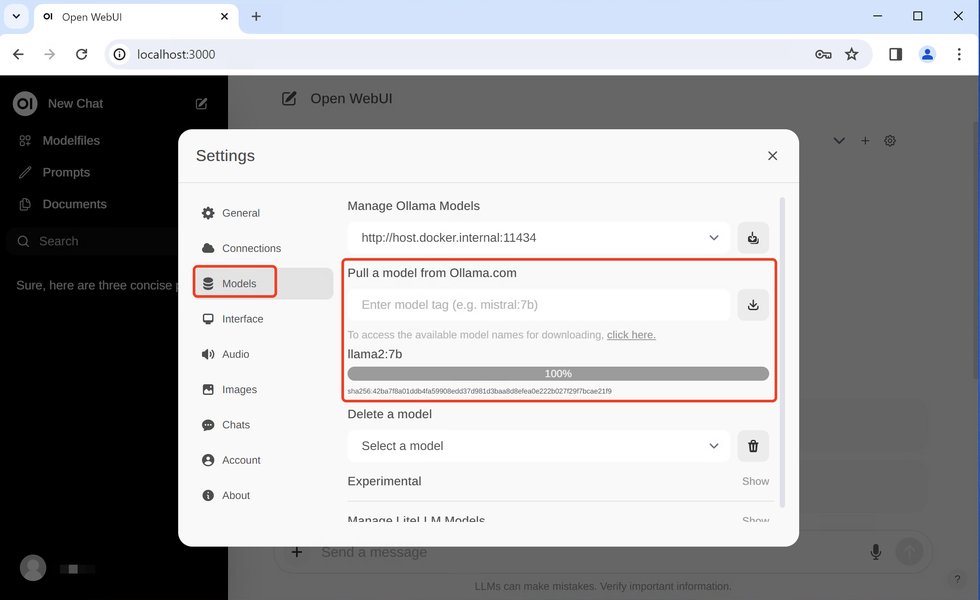

Панель управления моделями в Ollama.

Пошаговое Руководство по Запуску LLM через Ollama

- Установите Ollama: Загрузите и установите Ollama для вашей операционной системы. Он поддерживает Mac, Linux и Windows (через WSL).

- Запустите Ollama: После установки запустите Ollama. Он будет работать в фоновом режиме.

- Загрузите Модель: Откройте командную строку (терминал) и используйте команду

ollama run [имя_модели]. Если модель не загружена, Ollama автоматически скачает ее. Например:ollama run llama2-uncensored. - Взаимодействуйте с Моделью: После загрузки модель будет готова к приему запросов. Вы можете вводить свои промпты прямо в командной строке.

В следующем разделе представлен структурированный список наиболее популярных и эффективных нецензурированных LLM, доступных через Ollama.

Нецензурированные LLM, Доступные через Ollama

Детальный Обзор Моделей и Их Особенностей

Ниже представлена таблица, содержащая ключевую информацию о нецензурированных LLM, которые можно установить и использовать через Ollama. Каждая модель обладает уникальными характеристиками и требованиями к ресурсам.

| Название Модели | Описание и База | Ключевые Особенности (Нецензурированность) | Параметры и Требования к ОЗУ | Команда Ollama для Запуска |

|---|---|---|---|---|

| Llama 2 Uncensored | Основана на Meta Llama 2, доработана Джорджем Сонгом и Джаррадом Хоупом. | Устранены встроенные фильтры Meta Llama 2, что позволяет более свободные и полные ответы. Снижен уровень галлюцинаций. | 7B, 13B параметров; 8-16 ГБ ОЗУ (для 7B). | |

| WizardLM Uncensored | Версия WizardLM с 13B параметрами, основанная на Llama 2 Uncensored от Эрика Хартфорда. | Создана без ограничений, для более полного и разнообразного генерируемого текста. Подходит для широкого круга задач. | 13B параметров; ~16 ГБ ОЗУ. | |

| Wizard Vicuna 13B Uncensored | Модель Llama 1 13B, дообученная на наборе данных Wizard-Vicuna для удаления "выравнивания". | Удалено выравнивание, что обеспечивает прямые и нефильтрованные ответы. Идеальна для диалогов с максимальной свободой высказывания. | 13B параметров; ~16 ГБ ОЗУ. | |

| Dolphin 2.7 Mixtral 8x7B | Модель Mixture of Experts (MoE) от Mistral AI, модифицированная для снятия цензуры. | Высокая производительность, особенно сильна в задачах кодирования. Лицензирована под Apache 2.0. | 8x7B параметров; требуется 64 ГБ ОЗУ. | |

| Dolphin 3 | Новейшая итерация серии Dolphin, полностью нецензурированная. | Предлагает нецензурированный опыт в различных задачах. | Аналогично другим Dolphin моделям (7-13B параметров); ~16-32 ГБ ОЗУ. | |

| Nous Hermes Llama 2 13B | Модель Llama 2 13B, дообученная на 300,000+ инструкций. | Отличается длинными и качественными ответами, низким уровнем галлюцинаций и полным отсутствием цензуры OpenAI-подобных механизмов. | 13B параметров; ~16 ГБ ОЗУ. | |

| DeepSeek R1 Uncensored | Экспериментальная реализация, сфокусированная на удалении отказов отвечать без TransformerLens. | Нацелена на устранение отказов модели помогать из-за встроенной цензуры. | До 3B параметров (потенциально больше); требования варьируются. | Для запуска требуются специфические инструкции, не стандартизированные в |

| Llama 3.1 Uncensored (Lexi) | Основана на Llama-3.1-8b-Instruct, управляется лицензией META LLAMA 3.1 COMMUNITY LICENSE AGREEMENT. | Модель Lexi представлена как нецензурированная, снижая цензурные ограничения. | 8B параметров; ~16 ГБ ОЗУ. | |

Оценка Характеристик Нецензурированных LLM

Сравнение Моделей по Ключевым Критериям

Для лучшего понимания сильных сторон каждой нецензурированной LLM, представленной выше, я составил радар-график, который оценивает их по нескольким важным критериям. Эти оценки основаны на обобщенной информации и мнениях пользователей, а также на заявленных характеристиках моделей. Они помогут вам выбрать модель, наилучшим образом соответствующую вашим задачам.

На этом радар-графике представлены следующие критерии:

- Гибкость Ответов: Насколько свободно модель генерирует ответы без цензуры.

- Качество Генерации: Общая связность, грамматика и содержательность ответов.

- Требования к Ресурсам: Насколько требовательна модель к ОЗУ и вычислительной мощности.

- Скорость Инференса: Как быстро модель обрабатывает запросы и генерирует ответы.

- Полезность в Кодировании: Насколько хорошо модель справляется с задачами по генерации и отладке кода.

- Устойчивость к Галлюцинациям: Способность модели избегать генерации ложной или выдуманной информации.

Влияние Нецензурированных LLM и Этические Аспекты

Свобода и Ответственность

Использование нецензурированных LLM предоставляет беспрецедентную свободу в генерации контента, однако это также сопряжено с серьезными этическими вопросами. Отсутствие встроенных фильтров означает, что модели могут генерировать вредоносный, дискриминационный, ложный или иным образом неприемлемый контент, если это запрошено пользователем.

Данная диаграмма демонстрирует ключевые аспекты использования нецензурированных LLM. С одной стороны, они предлагают огромные преимущества в гибкости и исследованиях. С другой, они несут значительные риски, связанные с потенциальной генерацией неприемлемого контента. Крайне важно использовать эти модели ответственно, с полным пониманием их возможностей и ограничений. Разработчики и пользователи должны внедрять дополнительные меры безопасности, такие как ручная модерация или разработка собственных фильтров, чтобы обеспечить этичное и безопасное развертывание.

Обучающие Видео: Запуск Нецензурированных LLM

Практические Руководства по Использованию Ollama

Для тех, кто предпочитает наглядные инструкции, существует множество обучающих видеороликов, демонстрирующих процесс установки и запуска нецензурированных LLM через Ollama. Эти видео охватывают все шаги, от загрузки Ollama до взаимодействия с различными моделями.

Видео "How to install an uncensored AI model locally with Ollama?" предоставляет пошаговое руководство по установке нецензурированной модели ИИ локально с использованием Ollama. Оно демонстрирует процесс загрузки и запуска модели, что очень полезно для начинающих пользователей, желающих быстро приступить к работе.

Это видео является отличным ресурсом, который дополняет текстовые инструкции, представленные выше. Оно наглядно показывает, как установить Ollama, выбрать и загрузить нецензурированную модель, а затем начать взаимодействие с ней. Такие видеоролики особенно ценны для тех, кто хочет убедиться в правильности каждого шага установки и избежать потенциальных ошибок.

Часто Задаваемые Вопросы (FAQ)

Заключение

Нецензурированные LLM, доступные через Ollama, открывают новые горизонты для исследований, разработки и творчества, предлагая беспрецедентную свободу в генерации контента. Хотя эти модели и устраняют встроенные фильтры, крайне важно подходить к их использованию ответственно, осознавая потенциальные этические риски. Ollama значительно упрощает процесс локальной установки и взаимодействия с этими мощными инструментами, делая их доступными для широкого круга пользователей. Выбирая подходящую модель и понимая ее характеристики, вы сможете максимально эффективно использовать возможности нецензурированных LLM в своих проектах.

Рекомендуемые Запросы для Дальнейшего Изучения

- Как создать собственные нецензурированные LLM?

- Сравнение Ollama и LM Studio для локальных LLM

- Этические рамки для использования нецензурированных ИИ

- Лучшие веб-интерфейсы для Ollama